Aggasztó az új kínai AI: vajon biztonságos a Manus, ami már önállóan cselekszik is?

A kínai Manus startup Monica névre keresztelt MI-ügynöke az egyik első olyan AI-platform lett, amely néhány napja hivatalosan is engedélyt kapott generatív MI-szolgáltatások nyújtására Kínában.

Az új mesterséges intelligencia alkalmazást kifejlesztő, kínai szoftvermérnökökből álló csapat szerint a Manus a világ első teljesen önálló AI-ügynöke, és mint ilyen, talán még jobban borzolja a kedélyeket, mint a ChatGPT-vel konkuráló DeepSeek. Már csak azért is, mert előbbiek jóval kevésbé komplikált folyamatokat futtatnak és maguktól nem hajtanak végre feladatokat - ellentétben az AI-ügynökökkel.

A Microsoft riportja szerint az AI-ügynökök megjelenéséig több evolúciós lépcső vezetett el. Először jöttek a nagy nyelvi modellek, az LLM-ek, amelyek egyszerűen csak válaszoltak a felhasználó kérdéseire, egy hatalmas betanított adatkészlet alapján. Utánuk érkeztek a kezdetben rögzített eszközkészlettel kombinált LLM-ek, amelyeknek később megjelent egy információ-lekérdezéssel bővített generációja, hogy bonyolultabb feladatokat tudjanak elvégezni.

Az AI-ügynökök az LLM-rendszerekhez hasonlóan eszközöket használnak, viszont az már nem a felhasználón, hanem rajtuk múlik, hogy melyiket, mikor és hogyan alkalmazzák. Ebbe a világba csöppen bele a nagyközönség a legutóbbi innovációval, a Manussal, ami ugyan nem az első AI-ügynök a világon, viszont úttörő abból a szempontból, hogy az eddigi, például zárt, vállalati rendszerekkel ellentétben minden felhasználó számára elérhetővé válik - valamikor a közeljövőben, mert a használata egyelőre előzetes jelentkezéshez és meghíváshoz kötött. Ez talán nem sokáig lesz így, mert a fejlesztők hivatalosan csak a korlátozott szerverkapacitásra hivatkozva nem eresztik szabadon. Ami gyorsan megváltozhat.

Tényleg autonóm AI, vagy csak annak hirdetik?

A Forbes riportja alapján a kínai Butterfly Effect által fejlesztett Manus jó okkal nevezhető AI-ügynöknek, hiszen a chatbotokkal, így például az OpenAI ChatGPT-jével, a Google Geminijével vagy Elon Musk xAI Grokjával szöges ellentétben nem igényli részletekbe menő emberi utasítások bevitelét. Önállóan jut nagyon összetett eredményre, és utána cselekszik is.

Egy egyszerű példával szemléltetve: ha a Manust megkérjük, hogy találjon egy eladó vagy kiadó lakást, akkor a szempillantás alatt begépelt utasítás nyomán összetett folyamatok indulnak el. A tökéletesen megfelelő lakás kiválasztásához figyelembe veszi a közbiztonsági szempontokat és a bűnözési statisztikákat, a közlekedést, az időjárási körülményeket, de még az ingatlanpiaci trendeket is, hogy biztosan jól járjunk. De ez csak egy keresés, aminél jóval többre képes.

A South China Morning Post - amely szerint a Manus ismét megkérdőjelezi a narratívát, hogy az Egyesült Államok a világ vezető AI-fejlesztője - arra jutott, hogy a Manus nyugdíjazhatja több gazdasági szegmens eddig alkalmazott gyakorlatait. Fontos szerep juthat neki például a munkaerő-toborzás területén, mivel önállóan elemez önéletrajzokat, hasonlít össze munkaerőpiaci trendeket és hoz meg optimális toborzási döntéseket - amelyek mellett elemzésekkel és jelentésekkel érvel. Szintén lehetséges felhasználási területe lehet a szoftverfejlesztés: egy ilyen AI-ügynök a semmiből képes felépíteni egy profi weboldalt, vagy alkotni egy egyedi igényekre szabott programot. Bár a a ChatGPT is tud Python kódot írni, de a Manus önállóan is le is futtatja, teszteli és finomítja. A fejlesztői „univerzális problémamegoldó eszköznek” tekintik.

A Manus oldala mindezen felül azt állítja - és ehhez bemutatókat is csatol -, hogy az AI-ügynökre rábízhatjuk utazás megszervezését (a célpont kiválasztásától a szállás lefoglalásáig), részvénypiacok és értékpapírok elemzését, tudományos munkák és kutatások vagy prezentációk elkészítését, webshopok teljesítményének analizálását, videojátékok programozását és például egy sor tartalomkészítő feladattípus végrehajtását.

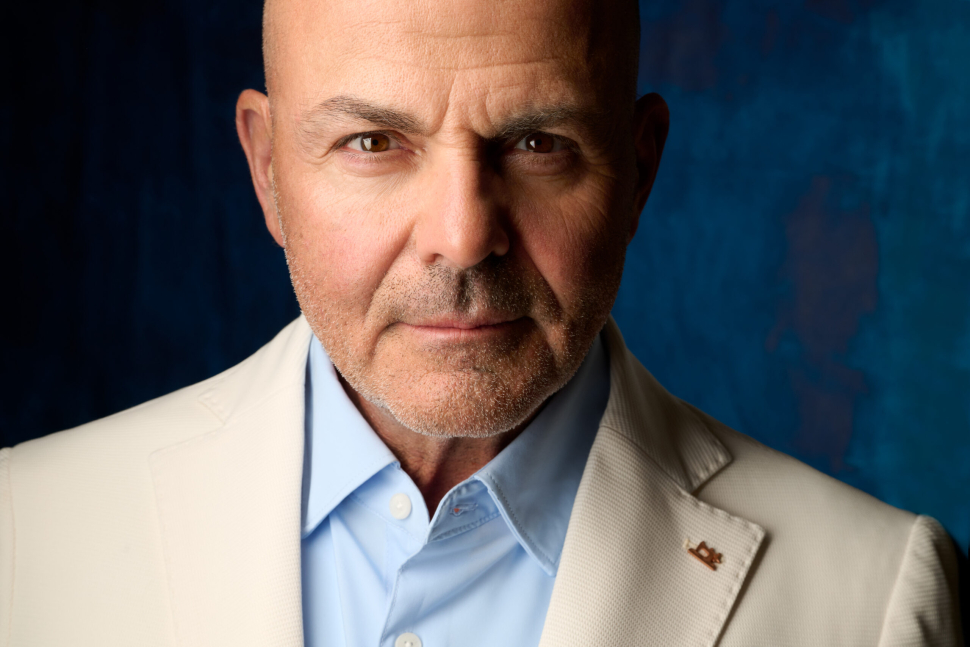

Ez „több, mint egy újabb chatbot vagy munkafolyamat... Ez egy teljesen autonóm ügynök” - nyilatkozta a Manusról a Butterfly Effect társalapítója és vezető tudósa. Yichao „Peak” Ji a fenti videóban hozzáteszi: a rendszerre úgy tekintenek, mint „az ember és gép közötti együttműködés következő paradigmájára”, ami „bepillantást enged az AGI-ba”. Utóbbi elnevezést, az ún. „Artificial General Intelligence-t” olyan (ma még minden bizonnyal nem létező) mesterséges intelligenciákra utalva használják, amelyek elérik vagy meghaladják az emberi gondolkodás képességeit - és amelyek felett el is veszíthetjük az irányítást.

Nem derült égből érkezett

A Manus nem a nulláról épült, hanem meglévő nagy nyelvi modellekre, például az Anthropic-féle Claude és az Alibaba által kiadott Qwen rendszereire támaszkodik. A platform ennek ellenére nagy figyelmet kap, mert a fejlesztők állítása szerint kiemelkedő eredményeket ért el a teszteken. A Manus által közzétett grafikon szerint az OpenAI o3-alapú Deep Research ügynökét is felülmúlta.

Az Euronews szerint egyes AI-szakértők Kína „második DeepSeek-pillanatának” nevezik a Manus megjelenését – ezt írta róla legalábbis Rowan Cheung, a The Rundown AI hírlevél alapítója a LinkedInen. A szerző később saját tesztet végzett a platformon, amiről megállapította, hogy „olyan, mintha egyesült volna a Deep Research, az Operator, illetve a Claude Computer, és NAGYON jól működik”. Cheunggal szemben más szakértők úgy vélik, hiába tartják újabb nagy áttörésnek, a Manus valószínűleg nem felel meg a várakozásoknak.

„Az eddig látott demók alapján bőven van bizonyíték arra, hogy a Manus nem mindig találja el a helyes választ, vagy végtelen ciklusokba ragad” – jellemezte a kínai AI-t az Euronews Nextnek Bradford Levy, a Chicagói Egyetem adjunktusa, akinek nem csak ennyi problémája van a Manussal. „Összességében jelentős az átláthatóság hiánya azzal kapcsolatban, hogy mire is képes valójában.” A tudós szerint a felhasználók jobb, ha kétszer is meggondolják, milyen adatokat osztanak meg a Manushoz hasonló platformokkal, és érdemes megvizsgálni a vállalat kínai állampárttal való kapcsolatát is.

A Manus csak az adatgyűjtést szolgálja?

Kína nemzetbiztonsági törvénye előírja, hogy a vállalatok „támogatással, segítséggel és együttműködéssel” tartoznak az állami hírszerző szervezeteknek. Ez Levy értelmezésében azt jelenti, hogy a titkosszolgálatok hozzáférhetnek a mobil- és webalkalmazásokon megosztott adatokhoz.

Ha jobban megnézzük a Manust kifejlesztő - és nem mellesleg a ChatGPT 2022-es megjelenése előtt mindössze két hónappal alapított - Butterfly Effect hátterét, egészen konkrét jelei vannak az állami kapcsolatnak. A cég egyik legnagyobb támogatója a szintén kínai Tencent Holdings Limited, ami 2025 januárjában felkerült az Egyesült Államok azon vállalatokról vezetett listájára, amelyek vélhetően együttműködnek a kínai hadsereggel. Ennek ismeretében minimum aggasztó, hogy a technológiai óriás érdekeltségébe tartozik a kb. 1,4 milliárd felhasználóval rendelkező WeChat csevegőalkalmazás mellett a Manus is, és komoly felvásárlója videojáték-ipari cégeknek. Egyik legutóbbi zsákmánya pont a több százmillió mobilra telepített Angry Birds fejlesztője és üzemeltetője, a Riot Games.

Mintha senkit nem érdekelnének többé az AI-val járó kockázatok

A Manus működését elemző The Economist szerint az AI-ügynök „képernyőn végiggörgető automatikus keze nyugtalanító látvány”, hiszen anélkül képes az interneten keresztül feladatokat végrehajtani, hogy folyamatosan engedélyt kérne rá az emberi felhasználótól. A világ különböző AI laboratóriumai már régóta kísérleteznek ezzel a megközelítéssel, így a Manus különlegessége nem a puszta létezése, hanem az, hogy az alkotói teljes mértékben szabadjára engedik.

A lap szerint, ha valaki hosszabb ideig használja a Manust, hamar kiderül számára, hogy az eszköz messze áll attól, amit megbízhatónak és hasznosnak lehessen nevezni. Zavaros válaszok, frusztráló késések és végtelen hurkok keserítik meg a felhasználói élményt, így elég egyértelműnek tűnik, hogy a fejlesztők előbbre valónak tartották a gyors piacra lépést a kifogástalan működésnél.

Ez szöges ellentétben áll az amerikai AI-fejlesztők megközelítésével. Ők, részben épp’ biztonsági aggályok miatt - visszatartják az új fejlesztéseiket, és csak akkor engedik ki őket, ha már megfelelően kiforrottak. Az OpenAI például kilenc hónapot várt, mielőtt 2019-ben elérhetővé tette a GPT-2-t, míg a Google már 2020-ban belső tesztelés alatt tartotta a LaMDA chatbotot, de csak két évvel később adta ki, Bard néven.

A The Economist megjegyzi: a nagy műhelyek az AI-ügynökökkel kapcsolatban is óvatosak – és nem véletlenül. Ha egy mesterséges intelligencia szabad kezet kap, hogy saját maga találjon ki megoldásokat ahelyett, hogy minden lépésnél emberi utasításra várna, az nagyban növeli a lehetőséget, hogy kárt okoz. Az Anthropic és a Google például már bemutatták hasonló AI képességeit, de egyikük sem tette széles körben elérhetővé. Ezeket a rendszereket nemcsak a technológiai korlátok szabják meg, hanem a szigorú irányelvek is, és ezekhez szorosan hozzátartozik az, hogy rendszeresen vissza kell adni az irányítást a felhasználónak, vagy megállni, ha összetett feladat lezárásáról van szó. Magyarul: a döntés az ember kezében kell, hogy maradjon.

Egyes amerikai megfigyelők számára különösen fenyegetőnek tűnik, hogy a Manus kínai fejlesztésű, mert attól tartanak, hogy a nyílt forráskódok és az élesed verseny miatt mostantól gyakorlatilag bármilyen cég – legyen amerikai, kínai vagy más – előállhat hasonló AI-ügynökkel, ha kész komponenseket használ a felépítéséhez és hajlandó komoly kockázatot vállalni.

Fontos ugyanakkor leszögezni: pillanatnyilag semmi bizonyíték arra, hogy a Manus bármilyen veszélyes dolgot tett volna. A biztonság kérdése ettől független nem merülhet ki annyiban, hogy a nagy laborok teszteléseket végeznek a megjelenés előtt. Ehelyett a szabályozóknak és a vállalatoknak kell figyelemmel kísérniük azokat a rendszereket, amelyeket már használatban vannak, gyorsan kell reagálniuk a felmerülő problémákra, és ha szükséges, azonnal ki kell vonniuk a forgalomból a veszélyes technológiákat. Ahogy teszi azt példának okáért a nemrég érvénybe lépett, uniós AI Act is.